閱讀時間 11 分鐘

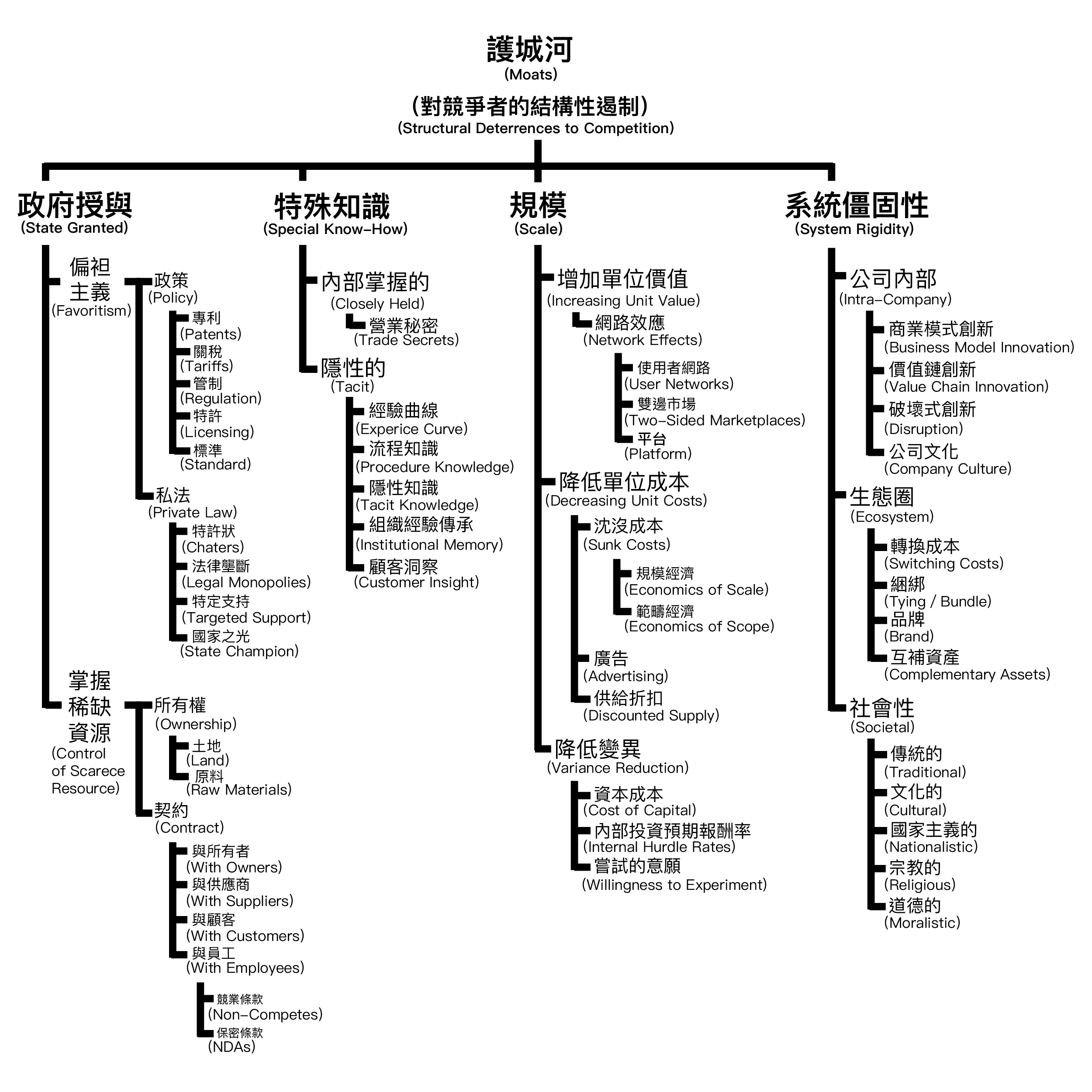

上週 Google 舉辦硬體發表會。最精彩的是知名工程師 Marc Levoy 展示 Pixel 4 的相機的橋段,例如拍下了這張照片:

用手機拍星空照!的確了不起。這是夜景(night sight)模式的延伸。相機結合了 16 張曝光 15 秒的影像,達到長時間曝光同時降低雜訊的效果。

不過,也只有介紹 Pixel 相機的那 10 分鐘充滿亮點。發表會的其餘部分都讓人昏昏欲睡。大概是因為 Google 不靠硬體賺錢。

不是核心業務

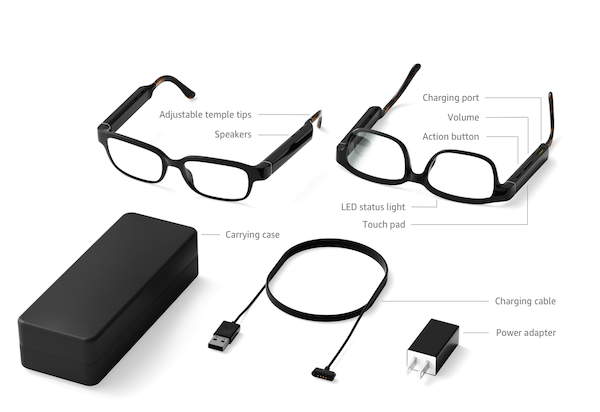

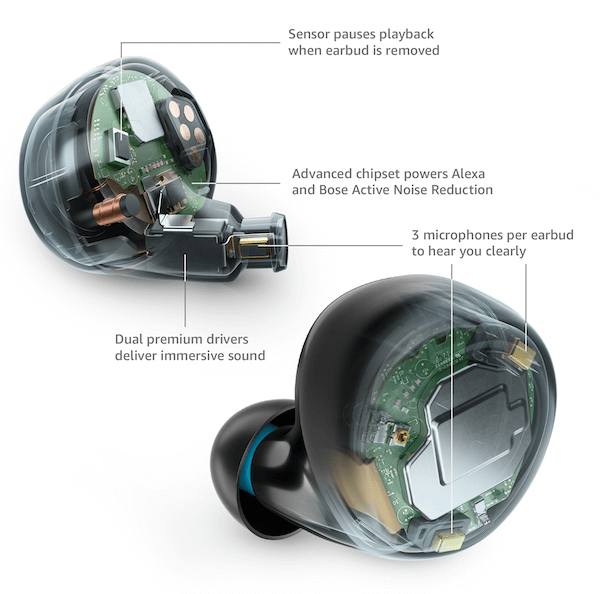

Google 超過 85% 的收入來自廣告。雖然硬體業務持續成長,但佔總利潤不到 5%。因此 Google 雖然有心做硬體,卻很難逼出賣硬體的積極性。這次 Google 雖然發表了一系列硬體產品,包括 Pixel 4 手機、Pixel Buds 無線抗噪耳機、Nest Hub Max / Mini 路由器以及 Nest Aware 監視系統等,但整場就是有一種無精打采的感覺。

貫穿發表會的是一段接一段的訪談,由一位作家訪談 Google 的內部員工,說明他們的設計理念。畫面溫馨;但看不出與顧客的關係。更像企業的公關廣告。

相較之下,蘋果發表會的重心永遠明確:賣貨。蘋果推銷得更積極兇猛,所有現場示範、宣傳影片,都是為了讓用戶想像擁有產品的感受。蘋果也會明確地說明發售日、定價,甚至解釋價格的競爭力。蘋果用力地推銷,顧客享受被推銷的感覺。

看 Google 發表會卻感受不到這種渴望,也看不出這是一年中最重要的行銷活動。我的感覺反而是 Google 不在乎賣得好不好,他們更重視堅持自己的理念。

發表會枯燥還有另一個可能原因:被剝奪的差異化優勢。

軟體、硬體與服務的未整合

手機大致可以拆成三大部分:硬體、作業系統與服務。以 Pixel 4 來說,也就是手機本身、Android 以及人工智慧,以 Google Assistant 為代表。問題是在這三者之中,Pixel 沒有獨佔後兩者 — Android 與 Google Assistant — 而是也開放給其他 Android 手機廠,如三星、小米。而 Android 與 Google Assistant 也被分到獨立的發表會去。

結果 Pixel 發表會能強調的只剩硬體。但「純」硬體如晶片、電池的研發也不是 Google 的強項,就只能再限縮到「用人工智慧做出差異化的硬體優勢」,例如一開始提到的相機。差異化就變得更小更窄了。

的確,Pixel 能拍攝星空非常厲害;但這已是非常小眾、非常細微的差異化。有多少人需要拍星空?一輩子會拍幾張星空照?很快的,蘋果也會追上。iPhone 可能沒辦法拍星空拍得那麼漂亮,但足夠滿足大部分人的需求,此一差異化又消失了。

事實上許多人開始注意到 Google「重軟輕硬」,在硬體上逐漸跟不上了。例如此次 Pixel 4 增加了許多耗能的新功能,包括雷達感知、語音聽寫等,電池卻只有 2,800 mAh,低於業界平均;耗電數據更不明。這有可能是硬體開發沒跟上,也可能是怕加大電池會拉高價格,侵蝕利潤。但也反過來凸顯蘋果在強化功能、控制利潤的同時,仍能維持使用時間的可貴。

賣手機不只是賣功能,還包含研發、製造、銷售甚至保固,是一個綜合性的競爭。現在手機市場大勢底定,Google 想靠技術突破非常困難。Google 必須拉出一條新的戰線,那就是此次發表會正式提出的願景:普及運算(ambient computing)。

普及運算

Google 首次明確地指出其硬體業務的願景是普及運算。根據 Google 硬體部門負責人 Rick Osterloh 的開場致詞:

如果你觀察所有 Google 的產品,從搜尋到地圖、Gmail 到相簿,我們的使命是帶給你更有用(helpful)的 Google。開發出讓你增加知識、成功、健康與快樂的工具。我們將此一願景應用在硬體與服務上,那就是要創造如新的 Pixel 手機、穿戴式裝置、筆記型電腦與家中的 Nest 裝置。每一個都小心、負責任地設計,協助你但不干擾你的生活。

. . . . 裝置一起合作,加上服務與 AI,讓你在任何地方需要時都能得到幫助。它是流動的。科技在你不需要的時候就褪入背景之中。裝置不再是系統的核心,你才是。這是我們對普及運算的願景。

什麼是普及運算?如果看個人電腦的發展,是一個「由大到小」的歷程。從大型主機(Mainframe)、桌上型電腦一直到手機。接下來可能會更小,放在手腕上或是成為眼鏡,甚至「消失」,融入背景之中。不論走到哪裡,用戶只要招呼一下就可以用電腦 — 這就是普及運算的想像。

推動普及運算也符合 Google 的優勢:

- Google 掌握了手機作業系統之一

- Google 擅長軟體服務業,掌握 Gmail、Google Maps 等工具

- Google 在人工智慧上領先

願景成立,問題是要如何落實到商業上賺錢?Google 硬體部門想賣硬體賺錢,但 Google 總公司卻把 Android 與 Google Assistant 開放,想從廣告或服務中賺錢。造成 Google 硬體部門處於劣勢。這是 Google 尚未解決的問題。

不過在技術上,Google 已經大踏步向前,用力推動由手機轉移到普及運算的典範。同時也暴露出新的問題。

手機的監視雷達

如果電腦能夠「在你不需要的時候就褪入背景中」,就代表電腦必須隨時隨地懂你的需要。換言之,普及運算必須有普及監視。這可以用 Pixel 4 中新增的移動感知(motion sense)功能為例(The Verge):

移動感知功能基本上有三種互動 . . . .

第一種是存在(presence)。Pixel 4 放在桌上時,裡面的 Soli 微型雷達晶片能在手機周圍產生一個感知的「泡泡」. . . 半徑約 2 呎的半球。手機會注意四周,並在你遠離手機時自動關閉螢幕。

第二種是觸及(reach). . . 手機會注意你伸手拿手機,並快速地開啟螢幕以及面部解鎖感測器。如果手機的警告或鈴聲響起,它看到你伸手時會自動降低音量。

最後,是實際的手勢(gestures),只有兩種。你可以揮手回絕電話或是按停鬧鐘。你也可以向左或向右揮,讓音樂向前或向後跳。

裝上雷達晶片,讓 Pixel 4 可以感知周圍的環境,可以預先針對用戶的行動提早因應。這讓手機可以離用戶更「遠」,成為背景的多種電腦之一。但也增加了手機監視用戶的手段。

Google 很小心地稱此為雷達,而不是相機,並說雷達無法捕捉用戶的樣貌。但雷達用來監視的歷史可能比相機更久。該尺寸的雷達不但能辨識手勢,也可以輕易辨識人的姿勢(躺或坐),或是周遭人數。不難想像或許未來電腦可以偵測用戶是在看廣告,或是轉頭了?播放 Spotify 的對象是一個人,還是餐廳的一群人?(違反使用者條款)

隱私是普及運算的一道難題。傳統電腦是「一個指令一個動作」。電腦等人指揮,因此不需要預先知道人的狀態。可是普及運算需要預測人類行為,就必須掌握人類的想法,就有可能侵犯隱私。

普及運算的另一個難題是價值判斷。不論是 Google Assistant 或 Siri,都只能一次呈現一個答案;不像傳統電腦介面,可以呈現一排選項。電腦要推薦最好的答案,就必須做價值判斷。

魔鏡啊魔鏡,誰是最好的相機?

許多人喜歡爭論哪一台手機的相機最好。我有答案:見仁見智。未來的相機不會是好壞之分,而是風格之分。

例如一開頭提到的星空照,就牽涉到許多價值判斷。Marc Levoy 指出 Pixel 4 用了多種技術。包括:

- 用機器學習調整白平衡。

- 用語義分割(semantic segmentation)辨識照片的內容。

- 用計算攝影(computational photograph)剔除因長時間曝光而過熱的像素。

換言之,Pixel 4 首先判斷「現在要照一張星空照」。再根據由資料庫所訓練出的模型,設定基本的白平衡參數。接著,Pixel 4 再透過語義分割判斷「上半部是星空,下半部是地面」,因此強化地面與星空的邊界,同時降低星空(上半部)的雜訊。最後,再保留正常的像素所捕捉的資訊,剔除過度曝光的像素。

因此這一張照片不僅利用現場的資訊,也融入了其他人(在資料庫中)的照片。甚至還加入 Google 的審美觀!根據 CNET 報導:

Google 會針對 HDR+ 做美學判斷,從數百年前的義大利藝術家身上擷取靈感。

「我們可以從藝術中學習,」Levoy 在 Pixel 發布影片中說。「我一直都是卡拉瓦喬(Caravaggio)的粉絲,」其繪畫有強烈的明暗對比與深度的陰影。「這一直都是 HDR+ 的效果特色。」

在 Pixel 4 上,Google 開始傾向藝術家提香(Tiziano Vecellio)的明亮感。「我們今年稍微調整了一些,不再有那麼重的陰影了。」Levoy 說。

那這張照片到底是我照的,還是 Google 照的?是我的風格,還是提香的風格?何時我可以「拒絕」Google 的價值判斷呢?

Levoy 甚至預告,未來 Pixel 4 將能捕捉橫跨 19 階(F-stop)亮度的畫面,例如同時包含月球表面地貌以及月光下的地球的照片。這種畫面根本不存在人類的視覺中!這非常厲害,但能說是一張「好」的照片嗎?

未來 Pixel 4 照片中的世界,會比人類實際的體驗更細節、更立體,也更美 — 因為加上了提香的美術指導。我們不用再多次拍照、測試不同的曝光條件 — Google 會推薦最好的結果。這或許不足以帶動 Google 的硬體脫穎而出,但會進一步建立普及運算的基礎,讓人們習慣交給電腦更多權利。等到人們再也不想輸入複雜的指令,就是普及運算起飛的時刻。